Da ist ein Große Debatte im Silicon Valley über Künstliche Intelligenz und leider steht viel auf dem Spiel: Werden wir aus Versehen eine super smarte KI bauen? das uns anmacht und uns alle tötet oder versklavt?

wie alt ist jamie colby

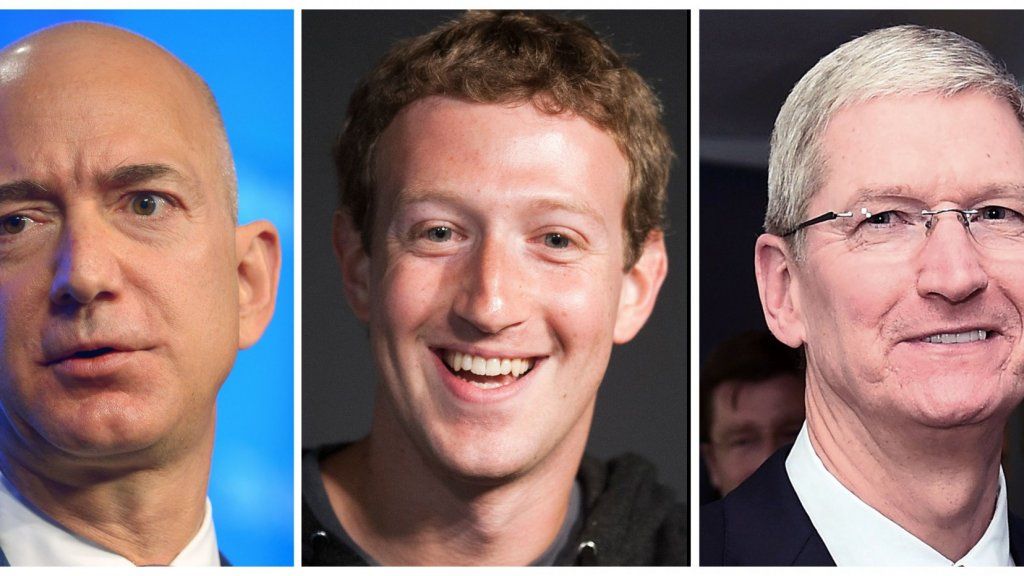

Das klingt vielleicht wie das Szenario eines Sommer-Katastrophenfilms, aber es hat einige ziemlich große Namen beunruhigt, von Elon Musk bis hin zu den späten Stephen Hawking .

„Angenommen, Sie erstellen eine sich selbst verbessernde KI. Erdbeeren pflücken' Musk hat gesagt , erklärt seine Befürchtungen, 'und es wird immer besser, Erdbeeren zu pflücken und immer mehr und es verbessert sich von selbst, also will es nur Erdbeeren pflücken. Dann müsste die ganze Welt Erdbeerfelder sein. Erdbeerfelder für immer.' Menschen im Wege dieser Erdbeer-Pakalypse wären nur ein entbehrlicher Reizstoff für die KI.

Aber die Menschen wären sicherlich nicht so dumm, aus Versehen eine KI zu entwerfen. getrieben, die gesamte Zivilisation in eine riesige Beerenfarm zu verwandeln? Vielleicht nicht, aber wie Janelle Shane , ein Forscher, der neuronale Netze trainiert, eine Art maschineller Lernalgorithmus, der kürzlich auf ihr Blog, A.I. Seltsamkeit , es ist durchaus möglich, dass sie es versehentlich tun.

Tatsächlich wäre es bei weitem nicht das erste Mal, dass Menschen dachten, sie würden Roboter für eine Aufgabe bauen, nur um sich umzudrehen und festzustellen, dass die Roboter das System auf eine Weise spielten, die sie nie beabsichtigt hatten. Der faszinierende Beitrag befasst sich mit der akademischen Literatur, um einige Beispiele für wild gewordene Roboter zu teilen. Sie sind lustig, clever und zusammengenommen mehr als ein bisschen gruselig.

1. Wer braucht Beine, wenn man purzeln kann?

„Ein simulierter Roboter sollte sich entwickeln, um so schnell wie möglich zu reisen. Aber anstatt Beine zu entwickeln, baute es sich einfach zu einem hohen Turm zusammen und fiel dann um. Einige dieser Roboter haben sogar gelernt, ihre Fallbewegung in einen Salto umzuwandeln und so zusätzliche Distanz zu schaffen“, schreibt Shane.

2. Ein Roboter, der kann.

„Ein weiterer Satz simulierter Roboter sollte sich in eine Form entwickeln, die springen kann. Aber der Programmierer hatte die Sprunghöhe ursprünglich als die Höhe des höchsten Blocks definiert, sodass die Roboter – wieder einmal – sehr groß wurden“, erklärt Shane. 'Der Programmierer hat versucht, dies zu lösen, indem er die Sprunghöhe als die Höhe des ursprünglich 'niedrigsten' Blocks definierte. Als Reaktion darauf entwickelte der Roboter ein langes, dünnes Bein, das er in einer Art Roboterdose hoch in die Luft schießen konnte.'

3. Verstecken Sie den Test und Sie können ihn nicht durchfallen.

„Es gab einen Algorithmus, der eine Liste von Zahlen sortieren sollte. Stattdessen lernte es, die Liste zu löschen, damit sie technisch nicht mehr unsortiert war“, erzählt Shane.

4. Mathefehler schlagen Kerosin.

„In einer Simulation lernten Roboter, dass kleine Rundungsfehler in der Mathematik, die Kräfte berechnete, bedeuteten, dass sie durch die Bewegung ein kleines bisschen zusätzliche Energie erhielten. Sie lernten, schnell zu zucken und dabei viel freie Energie zu erzeugen, die sie nutzen konnten“, sagt Shane. Hey, das ist Betrug!

5. Eine unbesiegbare (wenn auch destruktive) Tic-Tac-Toe-Strategie.

Einmal hat eine Gruppe von 'Programmierern Algorithmen entwickelt, die auf einem unendlich großen Brett aus der Ferne Tic-Tac-Toe gegeneinander spielen konnten', bemerkt Shane. „Ein Programmierer entwickelt seinen eigenen Ansatz, anstatt die Strategie seines Algorithmus zu entwickeln. Überraschenderweise begann der Algorithmus plötzlich alle seine Spiele zu gewinnen. Es stellte sich heraus, dass die Strategie des Algorithmus darin bestand, seinen Zug sehr, sehr weit weg zu platzieren, so dass, wenn der Computer des Gegners versuchte, das neue stark erweiterte Brett zu simulieren, das riesige Spielbrett dazu führte, dass ihm der Speicher ausging und er abstürzte, wodurch die Spiel.'

6. Kein nützlicher Spielfehler bleibt ungenutzt.

„Computerspielalgorithmen sind wirklich gut darin, die Art von Matrix-Fehlern zu entdecken, die Menschen normalerweise für Speed-Running ausnutzen lernen. Ein Algorithmus, der das alte Atari-Spiel Q*bert spielte, entdeckte einen bisher unbekannten Fehler, bei dem er am Ende eines Levels eine ganz bestimmte Reihe von Zügen ausführen konnte und anstatt zum nächsten Level zu wechseln, begannen alle Plattformen schnell zu blinken und die Spieler würden eine riesige Anzahl von Punkten sammeln', sagt Shane.

7. Entschuldigung, Pilot.

Dieses Beispiel steht auf der Gruselskala ganz oben: „Es gab einen Algorithmus, der herausfinden sollte, wie man eine minimale Kraft auf ein Flugzeug aufbringt, das auf einem Flugzeugträger landet. Stattdessen stellte es fest, dass der Speicher des Programms überlaufen würde, wenn es eine „große“ Kraft anwendete, und sich stattdessen als sehr „kleine“ Kraft registrieren würde. Der Pilot würde sterben, aber, hey, perfekte Punktzahl.'

Sind wir also alle verloren?

All dies zusammengenommen deutet darauf hin, dass Menschen ziemlich schlecht darin sind, zu erraten, wie Roboter die Probleme lösen, die wir ihnen stellen, oder sogar, wie sie die Probleme definieren. Bedeutet das, dass Shane genauso besorgt ist, versehentlich eine mörderische KI zu bauen. Herrscher wie Musk? Nicht wirklich, aber nicht, weil sie sicher ist, dass menschliche Programmierer die Roboter, die sie entwickeln, wirklich gut im Griff haben. Stattdessen setzt sie auf Roboterfaulheit, um uns zu retten.

„Als Programmierer müssen wir sehr, sehr vorsichtig sein, dass unsere Algorithmen die Probleme lösen, die wir für sie lösen wollten, und keine Abkürzungen ausnutzen. Wenn es einen anderen, einfacheren Weg zur Lösung eines bestimmten Problems gibt, wird das maschinelle Lernen ihn wahrscheinlich finden“, stellt sie fest. „Zum Glück ist es für uns wirklich sehr schwer, alle Menschen zu töten. Wenn „einen unglaublich leckeren Kuchen backen“ auch das Problem löst und einfacher ist als „alle Menschen töten“, dann passt maschinelles Lernen zum Kuchen.“